Fabrican objetos blandos y accionados utilizando máquinas de tejer comerciales

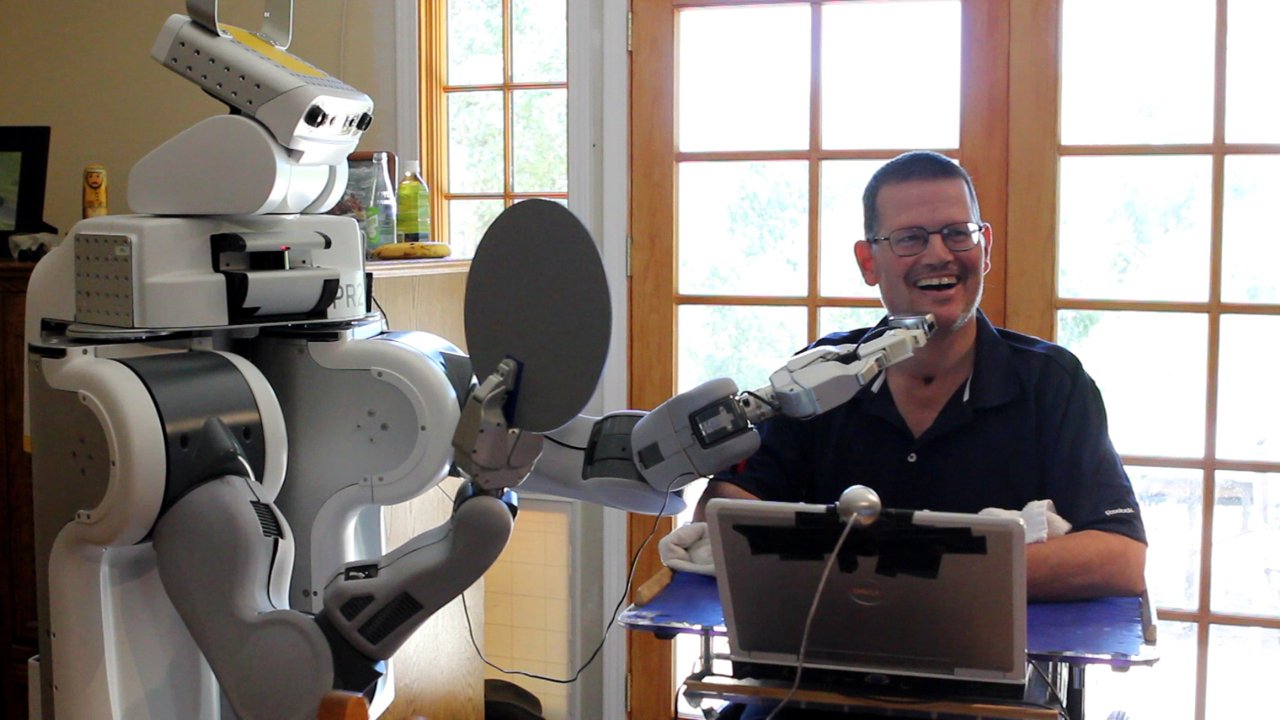

Los investigadores de la Universidad Carnegie Mellon han usado máquinas de tejer controladas por computadora para crear juguetes de peluche y otros objetos tejidos que son accionados por tendones. Es un enfoque que, según dicen, podría usarse algún día para hacer robots blandos y tecnologías portátiles.

para crear juguetes de peluche y otros objetos tejidos que son accionados por tendones. Es un enfoque que, según dicen, podría usarse algún día para hacer robots blandos y tecnologías portátiles.

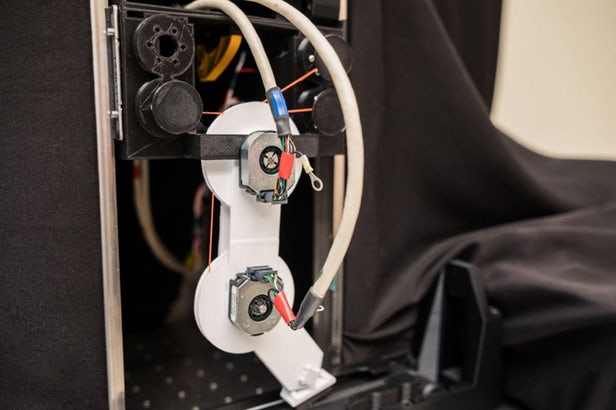

El software desarrollado por investigadores de Morphing Matter Lab y Dev Lab de CMU en el Human-Computer Interaction Institute hace posible que los objetos emerjan de las máquinas de tejer en sus formas deseadas y con los tendones ya integrados. Luego se pueden rellenar y los tendones se unen a los motores, según sea necesario.

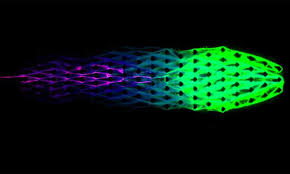

Lea Albaugh, una Ph.D. estudiante que dirigió el esfuerzo de investigación, desarrolló la técnica de inserción de tendones y exploró este espacio de diseño para hacer pantallas que cambian de forma, figuras rellenas que dan abrazos cuando se tocan en el estómago, e incluso un suéter con una manga que se mueve por sí solo. Aunque en gran parte son fantasiosos, estos objetos demuestran capacidades que podrían tener aplicaciones serias, como robots blandos (ver video).

«La robótica suave es un campo en crecimiento», señaló Albaugh. «La idea es construir robots a partir de materiales que sean intrínsecamente seguros para que las personas estén cerca, por lo que sería muy difícil lastimar a alguien. Los componentes blandos actuados serían baratos de producir en las máquinas de tejer comerciales.

«Tenemos tantos objetos blandos en nuestras vidas y muchos de ellos podrían interactuar con esta tecnología», agregó. «Una prenda de vestir podría ser parte de su sistema de información personal. Su suéter, por ejemplo, podría darle un golpecito en el hombro para llamar su atención. La tela de una silla podría servir como una interfaz háptica. Las mochilas podrían abrirse».

Fabricación digital de objetos de acción suave mediante tejido a máquina de Morphing Matter Lab

Albaugh y sus co-investigadores, Scott Hudson y Lining Yao, miembros de la facultad de HCII, presentarán su investigación en CHI 2019, la Conferencia de la Asociación para Maquinaria de Computación sobre Factores Humanos en Sistemas de Computación, del 4 al 9 de mayo en Glasgow, Escocia.

Las máquinas de tejer comerciales están bien desarrolladas y se utilizan ampliamente, pero generalmente requieren una programación minuciosa para cada prenda. Esta nueva investigación se basa en el trabajo anterior de CMU para automatizar el proceso, lo que facilita el uso de estas máquinas de producción en serie para producir diseños personalizados y únicos.

«Es una línea muy conveniente para usar para producir objetos de punto activos», dijo Yao, profesor asistente de HCII. Otros investigadores han experimentado con objetos textiles accionados, anotó, pero se han enfrentado a la tarea que lleva mucho tiempo de agregar tendones a los artículos terminados. Insertar tendones en los materiales a medida que se crean ahorra tiempo y esfuerzo, y agrega precisión a sus movimientos.

Los investigadores desarrollaron métodos para insertar líneas de tendones en forma horizontal, vertical y diagonal en láminas y tubos de tela. Mostraron que la forma de la tela, combinada con la orientación del recorrido del tendón, puede producir una variedad de efectos de movimiento, entre ellos curvas asimétricas, curvas en forma de S y giros. La rigidez de los objetos se puede ajustar rellenándolos con diversos materiales disponibles para los aficionados.

Se pueden usar tendones hechos con varios materiales, incluidos hilos de acolchado envueltos en poliéster, hilo de seda pura y monofilamento de nylon.

La estudiante Lea Albaugh desarrolló una técnica de inserción de tendones y exploró técnicas como hacer muñecos de peluche que dan abrazos cuando se los presiona en el estómago.

Además de activar los objetos, estas técnicas también pueden agregar capacidades de detección a los objetos. Al unir sensores a cada tendón, por ejemplo, es posible sentir la dirección en que se está doblando o torciendo el objeto. Al tejer con hilo conductor, los investigadores demostraron que podían crear tanto almohadillas de contacto para una detección táctil capacitiva, como sensores de tensión para detectar si una muestra está estirada.

Ya se está utilizando impresión 3D para hacer objetos personalizados, con movimientos y componentes robóticos, dijo Albaugh, aunque los materiales por lo general son duros. El tejido de punto controlado por computadora tiene el potencial de ampliar las posibilidades y hacer que los resultados sean más amigables para las personas.

«Creo que hay un enorme poder en el uso de materiales que las personas ya asocian con la comodidad», dijo.