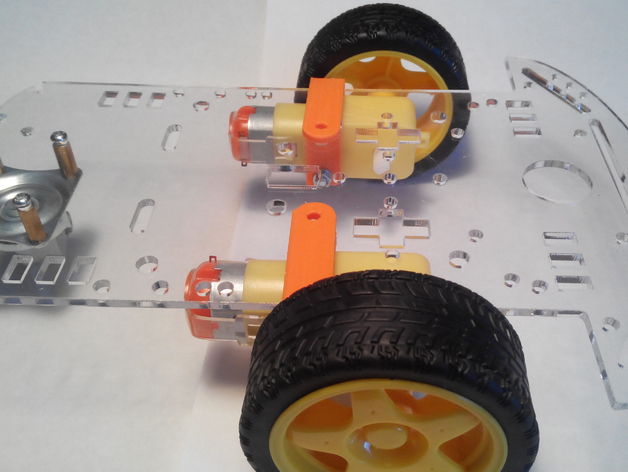

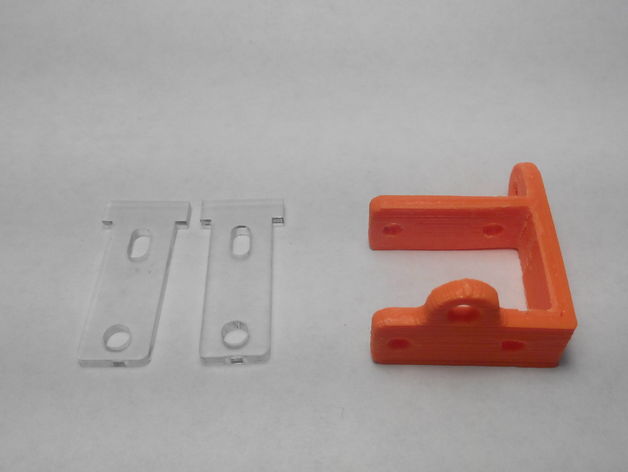

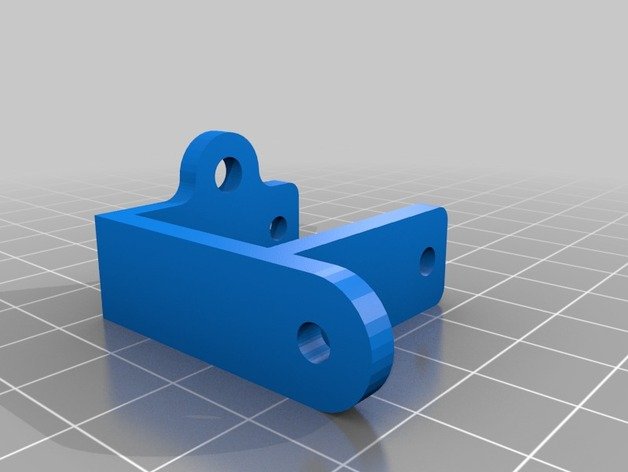

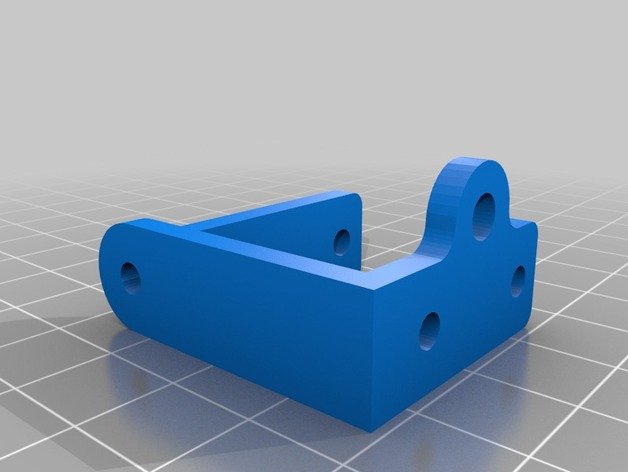

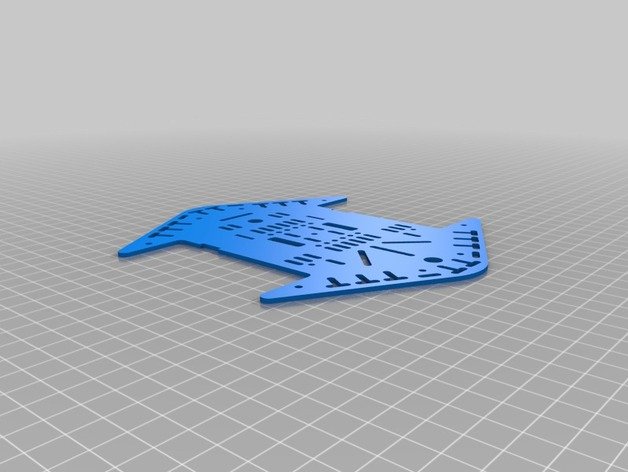

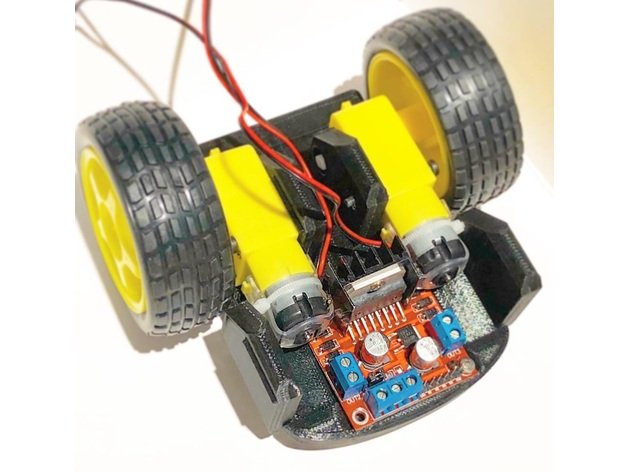

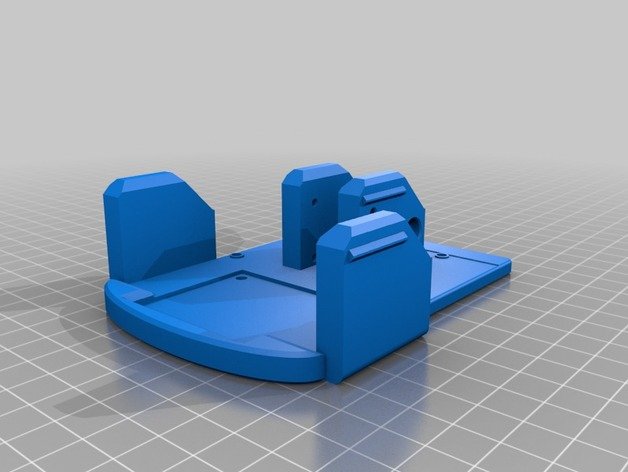

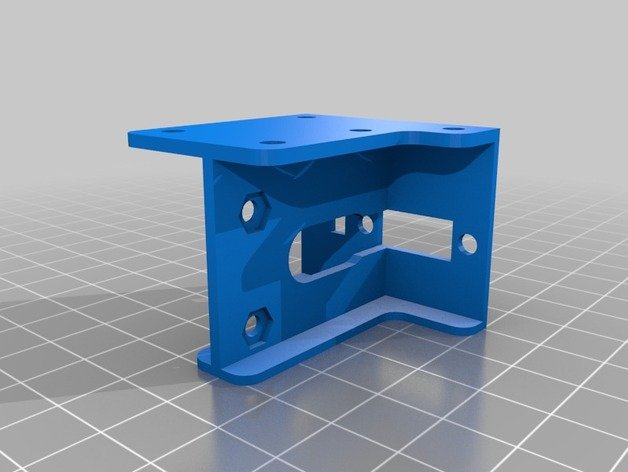

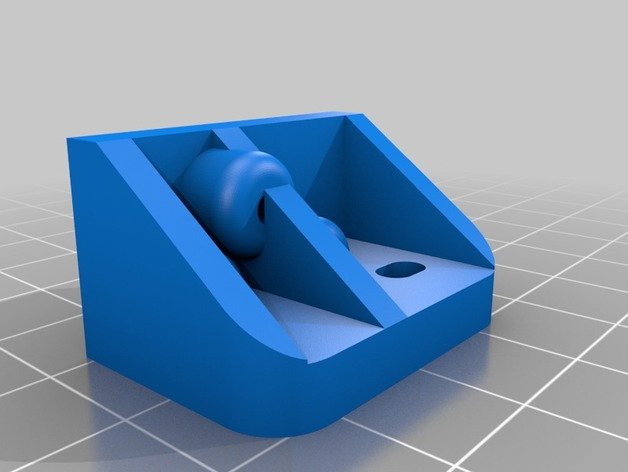

Soporte de motores, por zi3d

https://www.thingiverse.com/thing:750963

Enlaces para archivos de impresión

https://www.thingiverse.com/thing:750963/zip

Este soporte permite fijar los motores estándar de los kits más comunes con más firmeza, sin fijaciones que se rompen con facilidad, y sobre cualquier placa base del material que usted desee, sin necesidad de comprar las cortadas con láser.

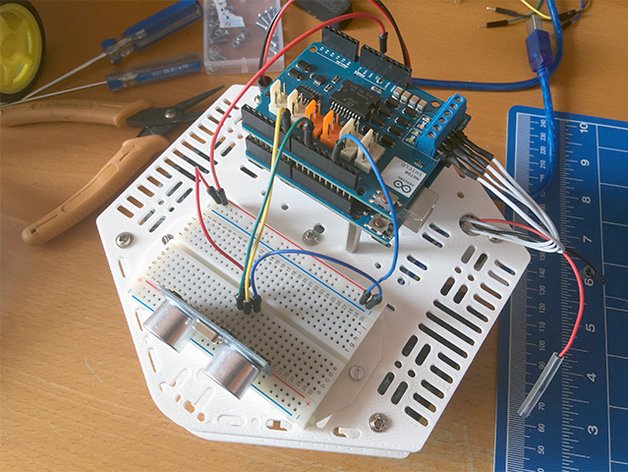

DotBot por Dotbot-io

https://www.thingiverse.com/thing:1441937

Enlaces para archivos de impresión

https://www.thingiverse.com/thing:1441937/zip

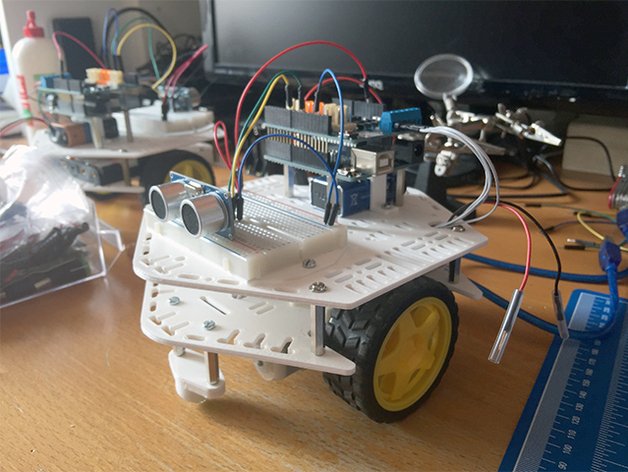

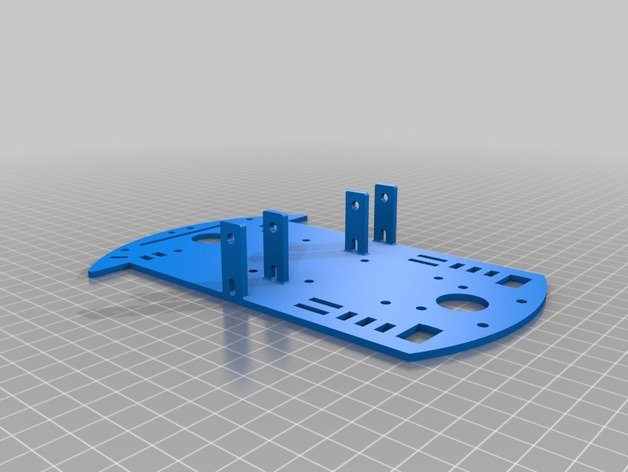

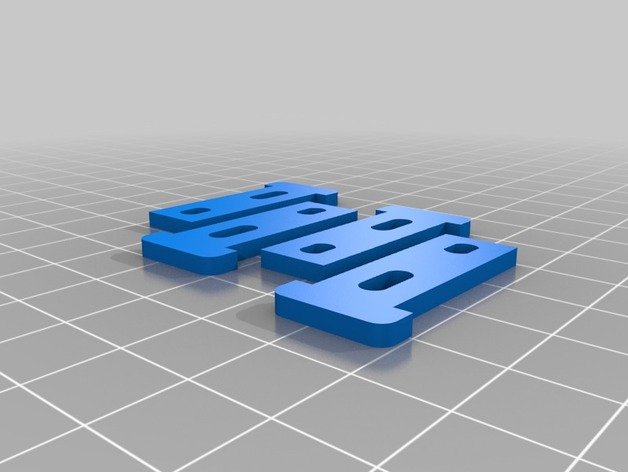

Chassis para robot por metshein

https://www.thingiverse.com/thing:1011890

Enlaces para archivos de impresión

https://www.thingiverse.com/thing:1011890/zip

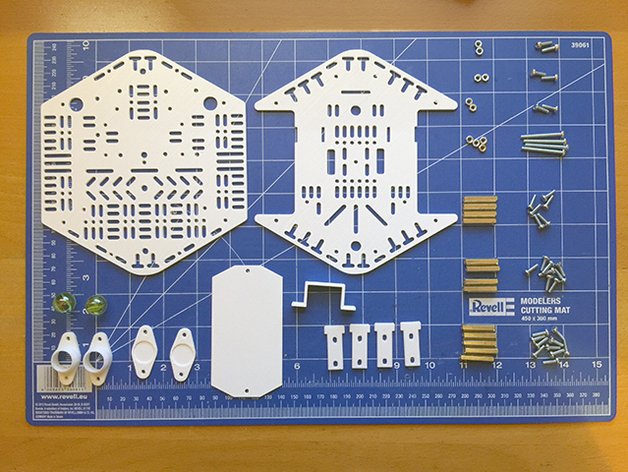

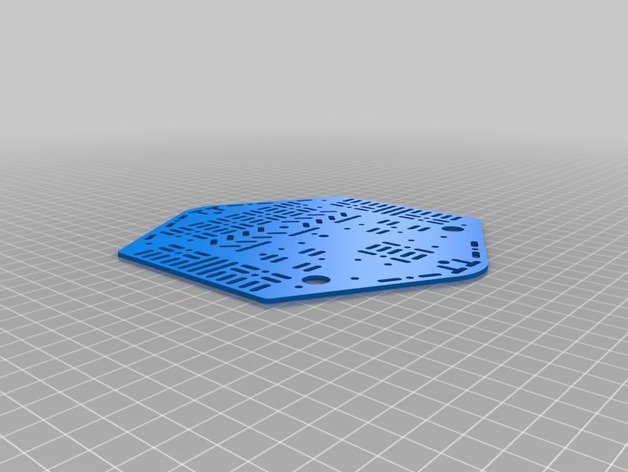

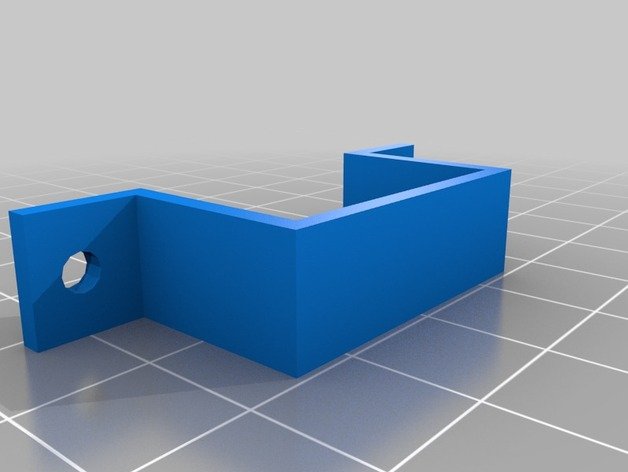

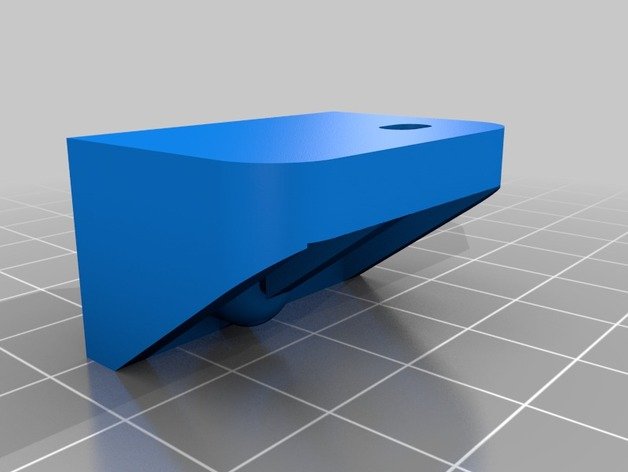

Chassis compacto por makerhacks

https://www.thingiverse.com/thing:2320298

Enlaces para los archivos (distintos modelos)

https://www.thingiverse.com/thing:2320298/zip

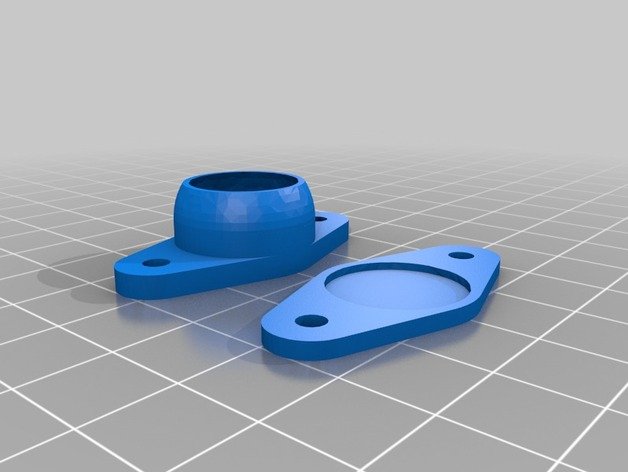

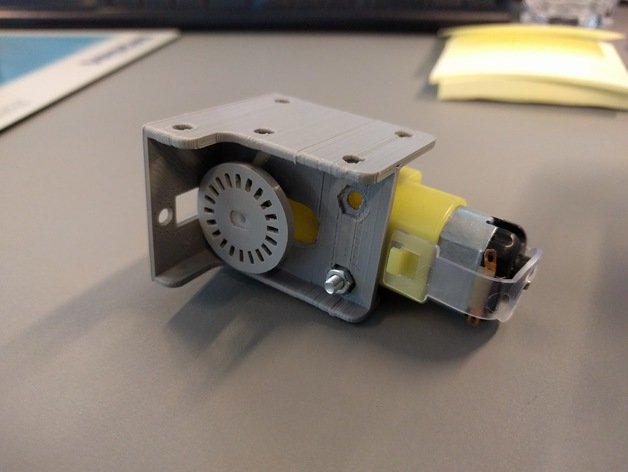

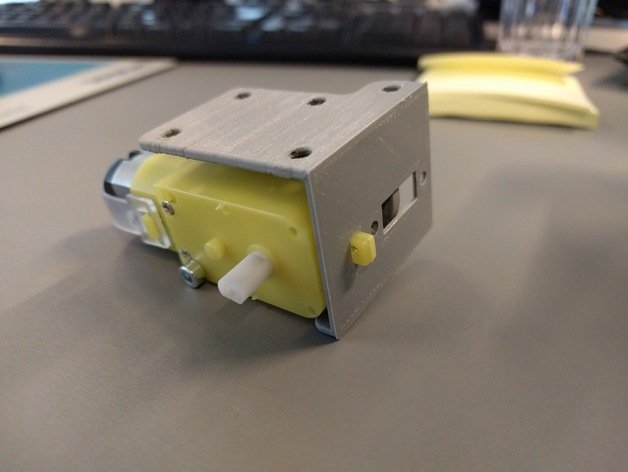

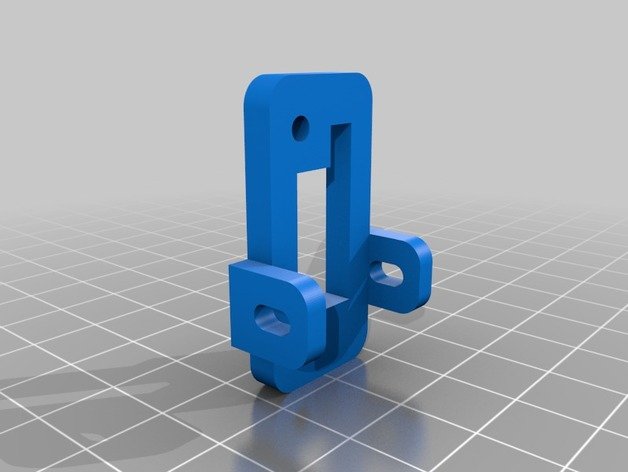

Montaje para motor con tacómetro por b2vn

https://www.thingiverse.com/thing:1473508

Archivos para impresión 3D

https://www.thingiverse.com/thing:1473508/zip

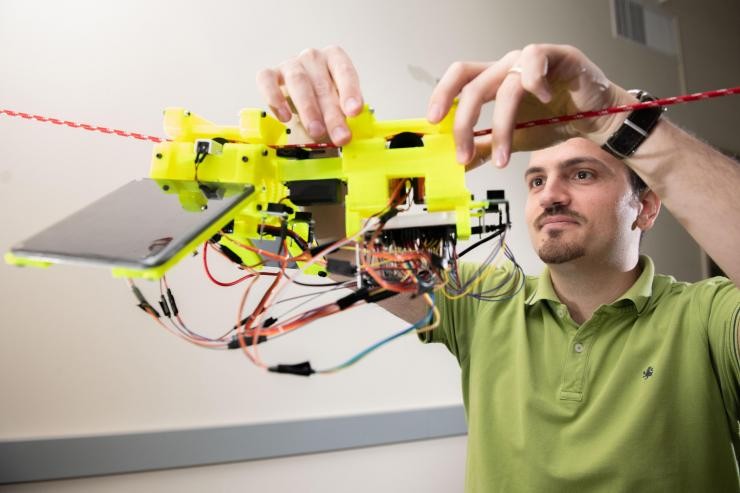

Montaje para motor, ruedas y orugas por edwardchew

https://www.thingiverse.com/thing:3228395

https://www.thingiverse.com/thing:3228359

Descargar todos los archivos para chassis y ruedas https://www.thingiverse.com/thing:3228395/zip

Descargar todos los archivos para orugas https://www.thingiverse.com/thing:3228359/zip

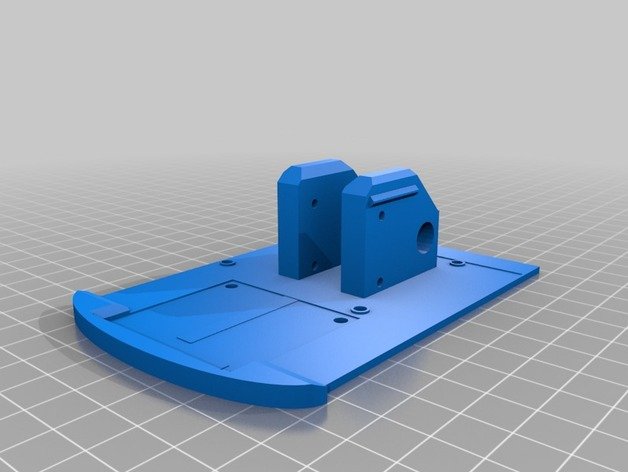

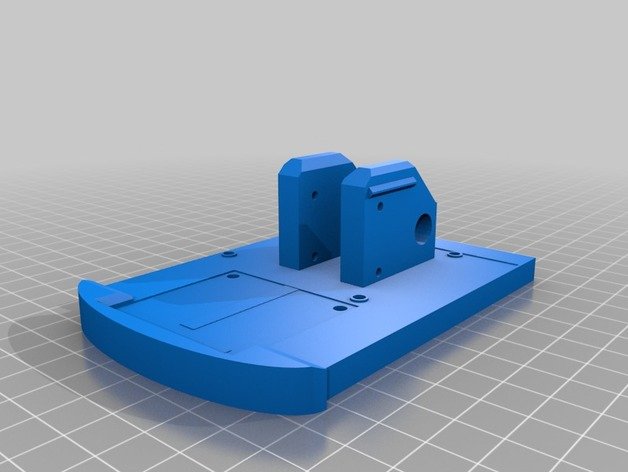

Chassis para robot por Malathar

https://www.thingiverse.com/thing:1316755

Enlaces de los archivos para impresión 3D

https://www.thingiverse.com/thing:1316755/zip

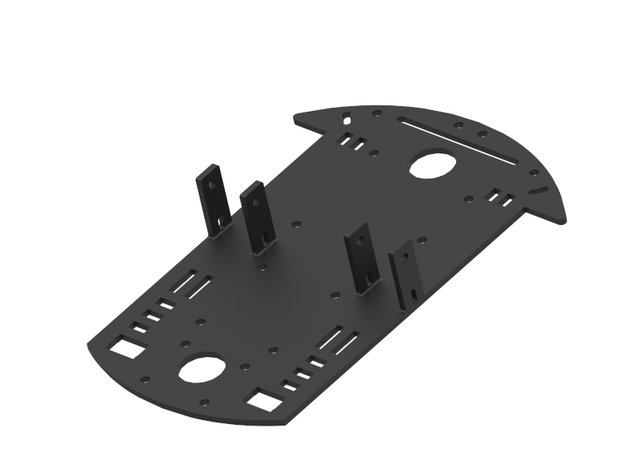

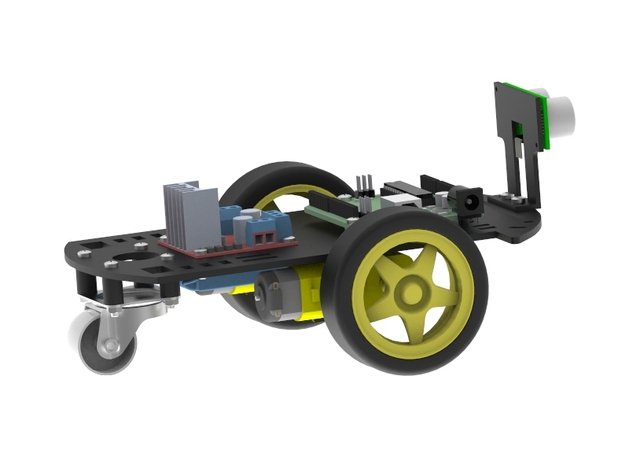

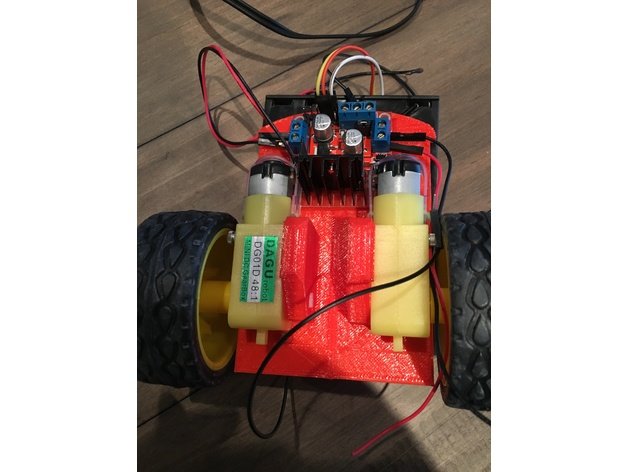

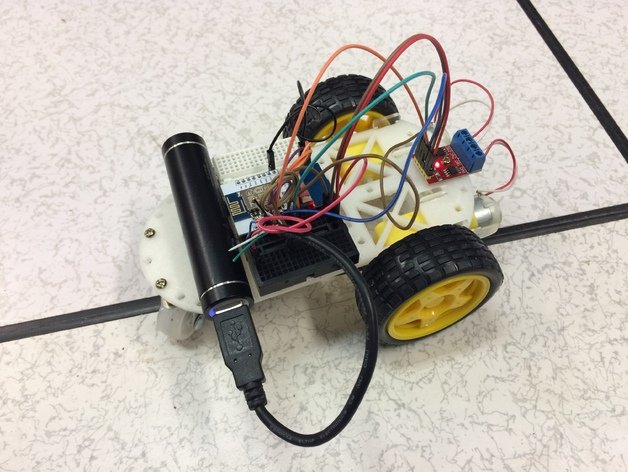

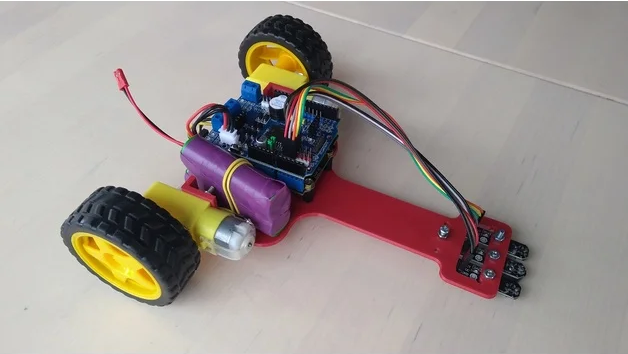

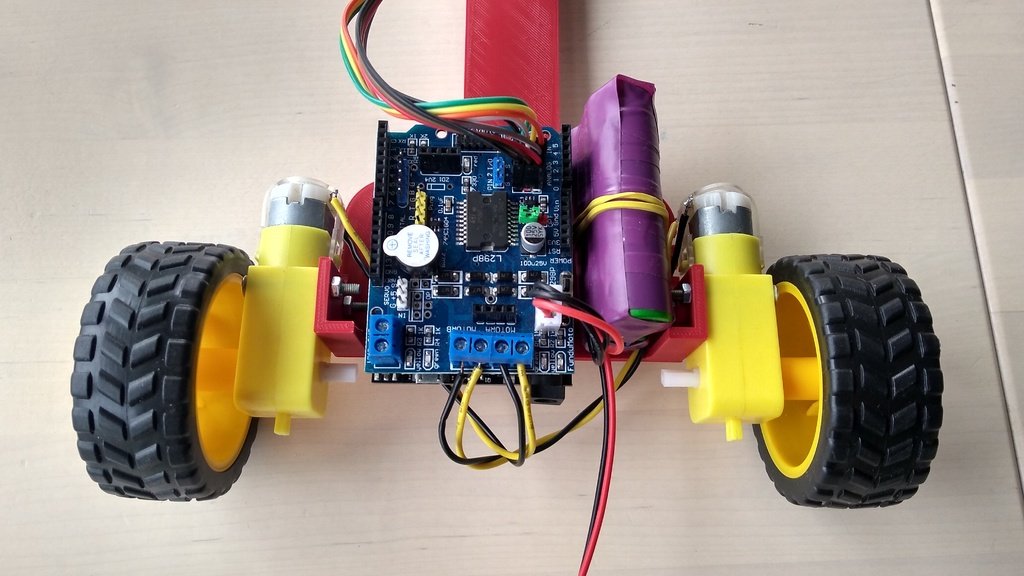

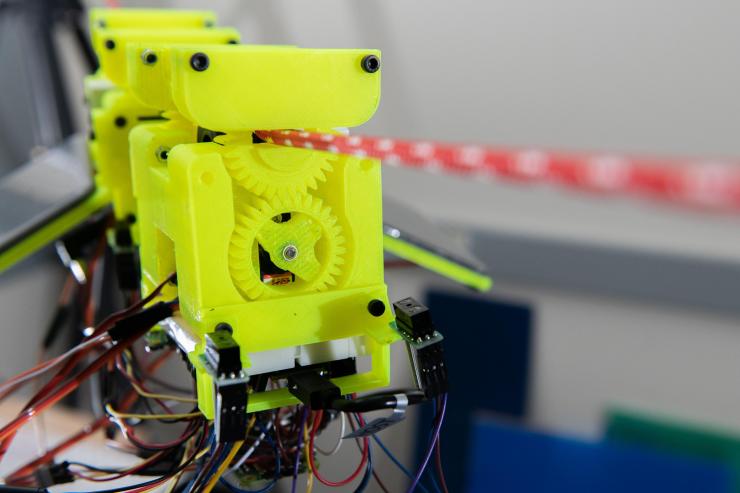

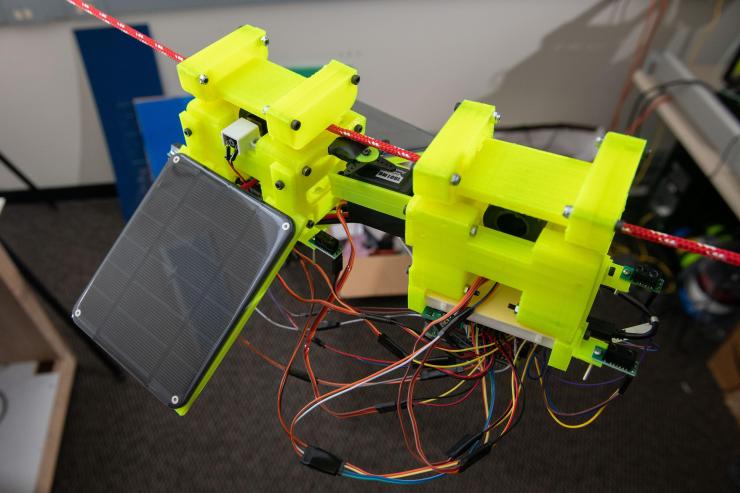

Seguidor de línea JJ1 por AndrewLinden

https://www.thingiverse.com/thing:2831729

Enlace para los archivos de impresión 3D

https://www.thingiverse.com/thing:2831729/zip

Es un chasis de robot para construir un robot seguidor de línea utilizando los motores amarillos de engranajes y un Arduino.

En lugar de los tres módulos de sensor de línea, también puede usar un conjunto de sensores de 8 canales.

El chasis tiene agujeros para esta placa de sensores también. Esta matriz tiene salida analógica y necesitas un Arduino Nano que posee pines adicionales A6 y A7 usar los 8 canales del sensor, que tiene salida analógica. También puede optar por agregar al Arduino uno un CD74HC4067, multiplexador de 16 canales.

Cuando use paquetes de batería LiPo sin protección, también debe usar un sensor de bateria Lipo con beeper como el de la imagen que sigue, o una protección similar.

Utilice un tornillo de cabeza redonda en uno de los orificios frontales. La parte frontal del robot se deslizará sobre ese tornillo.

Por supuesto, se pueden encontrar varios diseños más en el repositorio de diseños 3D https://www.thingiverse.com/