Un interfaz que utiliza la tecnología de realidad aumentada podría ayudar a las personas con profundas deficiencias motoras a operar un robot humanoide para alimentarse sin ayuda y a realizar la rutina de las tareas de cuidado personal, tales como rascarse una picazón y aplicarse loción para la piel. La interfaz basada en la web muestra la visión de un robot de los alrededores para ayudar a los usuarios a interactuar con el mundo a través de la máquina.

El sistema, descrito en la revista PLOS ONE, podría ayudar a hacer que los robots sofisticados sean más útiles para las personas que no tienen experiencia en la operación de sistemas robóticos complejos. Los participantes del estudio interactuaron con la interfaz del robot utilizando tecnologías estándar de acceso asistido por computadora, tales como rastreadores oculares y rastreadores de movimiento de la cabeza, que ellos ya estaban usando para controlar sus computadoras personales.

El documento informa sobre dos estudios que muestran cómo tales «sustitutos corporales robóticos», que pueden realizar tareas similares a las de los humanos, podrían mejorar la calidad de vida de los usuarios. El trabajo podría proporcionar una base para desarrollar robots de asistencia más rápidos y capaces.

«Nuestros resultados sugieren que las personas con deficiencias motoras profundas pueden mejorar su calidad de vida utilizando sustitutos corporales robóticos», dijo Phillip Grice, un reciente graduado Ph.D del Instituto de Tecnología de Georgia, quien es primer autor del artículo. «Hemos dado el primer paso para hacer posible que alguien compre un tipo apropiado de robot, lo tenga en su hogar y obtenga un beneficio real de él».

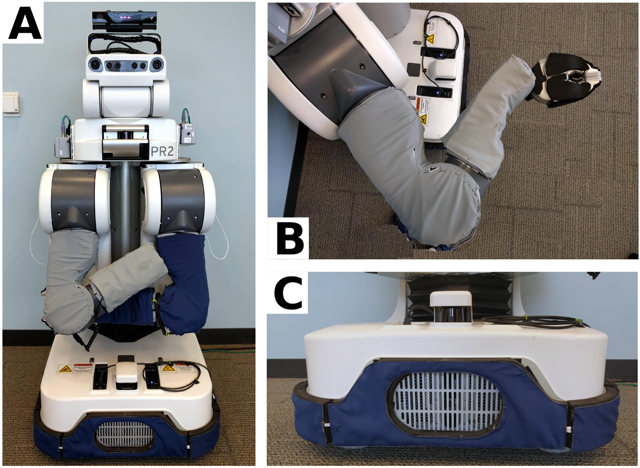

Grice y el profesor Charlie Kemp del Departamento de Ingeniería Biomédica de Wallace H. Coulter en Georgia Tech y Emory University utilizaron un manipulador móvil PR2 fabricado por Willow Garage para los dos estudios. El robot con ruedas tiene 20 grados de libertad, con dos brazos y una «cabeza», que le da la capacidad de manipular objetos como botellas de agua, paños, cepillos para el cabello e incluso una afeitadora eléctrica.

(A) El robot PR2. (B) Uno de los siete brazos DoF del robot, incluida la piel de tela táctil (gris) y el relleno de espuma (negro) en la pinza metálica. (C) La base del robot, incluida la piel de tela sensible al tacto (azul), colocada sobre el relleno de espuma.

«Nuestro objetivo es dar a las personas con uso limitado de sus propios cuerpos acceso a cuerpos robóticos para que puedan interactuar con el mundo de nuevas maneras», dijo Kemp.

En su primer estudio, Grice y Kemp pusieron el PR2 conectado a través de Internet para un grupo de 15 participantes con discapacidades motoras graves. Los participantes aprendieron a controlar el robot en forma remota, utilizando su propio equipo de asistencia que utilizaban para operar el cursor del mouse para realizar una tarea de cuidado personal. El ochenta por ciento de los participantes pudieron manipular el robot para recoger una botella de agua y llevarla a la boca de un maniquí.

«En comparación con las personas sanas, las capacidades del robot son limitadas», dijo Grice. «Pero los participantes pudieron realizar tareas de manera efectiva y mostraron una mejora en una evaluación clínica que midió su capacidad para manipular objetos en comparación con lo que hubieran podido hacer sin el robot».

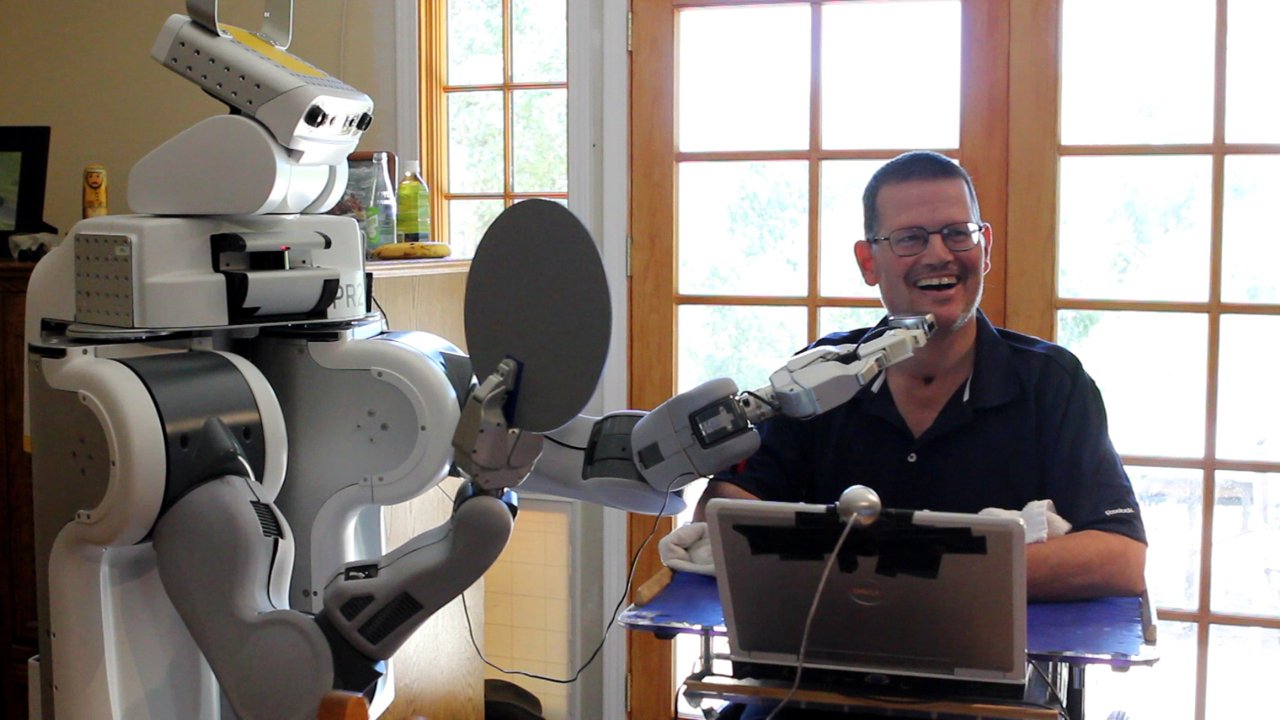

En el segundo estudio, los investigadores proporcionaron el PR2 y el sistema de interfaz a Henry Evans, un hombre de California que ha estado ayudando a los investigadores de Georgia Tech a estudiar y mejorar los sistemas de asistencia robótica desde 2011. Evans, que tiene un control muy limitado de su cuerpo, probó el robot en su casa durante siete días y no solo completó las tareas, sino que también ideó nuevos usos combinando la operación de ambos brazos de robot al mismo tiempo, usando un brazo para controlar una toalla y el otro para usar un cepillo.

«El sistema fue muy liberador para mí, ya que me permitió manipular mi entorno de forma independiente por primera vez desde mi ataque», dijo Evans. «Con respecto a otras personas, me emocionó ver a Phil obtener resultados abrumadoramente positivos cuando probó objetivamente el sistema con otras 15 personas».

Los investigadores se alegraron de que Evans desarrollara nuevos usos para el robot, combinando el movimiento de los dos brazos en formas que no habían esperado.

«Cuando le dimos a Henry acceso gratuito al robot durante una semana, encontró nuevas oportunidades para usarlo que no habíamos anticipado», dijo Grice. «Esto es importante porque gran parte de la tecnología de asistencia disponible en la actualidad está diseñada para propósitos muy específicos. Lo que Henry ha demostrado es que este sistema es poderoso para brindar asistencia y capacitar a los usuarios. Las oportunidades para esto son potencialmente muy amplias».

La interfaz le permitió a Evans cuidarse en la cama durante un período prolongado de tiempo. «El aspecto más útil del sistema de interfaz fue que podía operar el robot de forma totalmente independiente, con solo movimientos pequeños de la cabeza utilizando una interfaz gráfica de usuario extremadamente intuitiva», dijo Evans.

La interfaz basada en la web muestra a los usuarios cómo se ve el mundo desde las cámaras ubicadas en la cabeza del robot. Los controles sobre los que se puede hacer clic superpuestos en la vista permiten a los usuarios mover el robot en un hogar u otro entorno y controlar las manos y los brazos del robot. Cuando los usuarios mueven la cabeza del robot, por ejemplo, la pantalla muestra el cursor del mouse como un par de globos oculares para mostrar a dónde mirará el robot cuando el usuario haga clic. Al hacer clic en un disco que rodea las manos robóticas, los usuarios pueden seleccionar un movimiento. Mientras se conduce al robot alrededor de una habitación, las líneas que siguen al cursor en la interfaz indican la dirección en que viajará.

La construcción de la interfaz en torno a las acciones de un simple mouse de un solo botón permite a las personas con una variedad de discapacidades usar la interfaz sin largas sesiones de entrenamiento.

«Tener una interfaz que puedan operar los individuos con una amplia gama de discapacidades físicas significa que podemos proporcionar acceso a una amplia gama de personas, una forma de diseño universal», señaló Grice. «Debido a su capacidad, este es un sistema muy complejo, por lo que el desafío que tuvimos que superar fue hacerlo accesible a las personas que tienen un control muy limitado de sus propios cuerpos».

Si bien los resultados del estudio demostraron lo que los investigadores se habían propuesto hacer, Kemp está de acuerdo en que se pueden hacer mejoras. El sistema existente es lento y los errores cometidos por los usuarios pueden crear contratiempos significativos. Aún así, dijo, «la gente podría usar esta tecnología hoy y realmente beneficiarse de ella».

Evans sugirió que el costo y el tamaño del PR2 deberían reducirse significativamente para que el sistema sea comercialmente viable. Kemp dice que estos estudios señalan el camino hacia un nuevo tipo de tecnología de asistencia.

«Me parece plausible, basado en este estudio, que los sustitutos robóticos del cuerpo podrán proporcionar beneficios significativos a los usuarios», agregó Kemp.

Artículos relacionados:

■ Una prótesis que restaura la sensación de dónde está tu mano

■ Logran que los robots rastreen objetos en movimiento con una precisión sin precedentes

■ Dando sentido del tacto a los robots

Historia De Fuente:

Material proporcionado por el Instituto de Tecnología de Georgia.

Publicación de referencia:

Phillip M. Grice, Charles C. Kemp. In-home and remote use of robotic body surrogates by people with profound motor deficits. PLOS ONE, 2019; 14 (3): e0212904 DOI: 10.1371/journal.pone.0212904

Georgia Institute of Technology. «Seeing through a robot’s eyes helps those with profound motor impairments.» ScienceDaily. ScienceDaily March 2019.

Pingback: Guante lleno de sensores aprende las señales del tacto humano | Robots Didácticos